Ces derniers jours s'est déroulée sous nos yeux une folle intrigue technopolitique, sur fond d'ultimatums, de représailles et d'accords de couloir. Au cœur de l'actualité, elle a révélé des positions, et posé d'importants précédents. Retour sur les faits.

Juillet 2025. Anthropic, créateur de Claude AI signe un contrat de 200 millions de dollars avec le Pentagone. Leur modèle tourne déjà sur les réseaux militaires depuis 2024. Le contrat inclut des garde-fous.

3 janvier. L'armée américaine capture le chef d'État vénézuélien. Claude est utilisé dans l'opération qui fait plusieurs morts.

13 février. La presse le révèle. Un dirigeant d'Anthropic appelle Palantir, le sous-traitant militaire, pour savoir si Claude a bien servi au raid. Le ton de la question alarme Palantir, qui prévient le Pentagone.

Le Pentagone veut verrouiller l'accès avant qu'Anthropic ne le coupe. Hegseth impose une nouvelle doctrine et exige un accès à Claude pour "tout usage légal". Anthropic pose deux conditions non négociables : Pas de surveillance de masse des Américains. Pas d'armes entièrement autonomes. Cela ne l'empêche pas dans le même temps de pitcher à ce même Pentagone des essaims de drones.

24 février. Ça ne suffit pas. Pete Hegseth, secrétaire à la Guerre, pose un ultimatum. Accepter toutes les conditions ou perdre le contrat. Vendredi 27, 17h01, dernier délai. Le même jour, Anthropic relâche ses propres garde-fous de sécurité pour montrer patte blanche. Mais sur les deux lignes rouges, elle ne bouge pas.

💬 "Les combattants américains ne seront jamais pris en otage par les lubies idéologiques de la Big Tech. Cette décision est définitive."

26 février. Anthropic rejette l'offre finale. "Nous ne pouvons pas accepter en notre âme et conscience." regrette son patron, Dario Amodei.

27 février. Ça grouille. Elon Musk s’en mèle et tweete qu'Anthropic "déteste la civilisation occidentale". L'après-midi, Trump sur Truth Social. "NEVER ALLOW A RADICAL LEFT, WOKE COMPANY TO DICTATE HOW OUR GREAT MILITARY FIGHTS AND WINS WARS!" Toutes les agences fédérales doivent couper les ponts avec Anthropic. À 17h14, treize minutes après l'expiration du délai, Hegseth classe Anthropic "risque pour la chaîne d'approvisionnement", une première pour un label d'habitude réservé aux adversaires étrangers. Le soir, OpenAI, dont le président avait versé 25 millions de dollars au Super PAC pro-Trump, récupère le contrat encore chaud et signe sans sourciller avec le Pentagone. Aussitôt des centaines d'employés d'OpenAI et de Google écrivent une lettre de protestation.

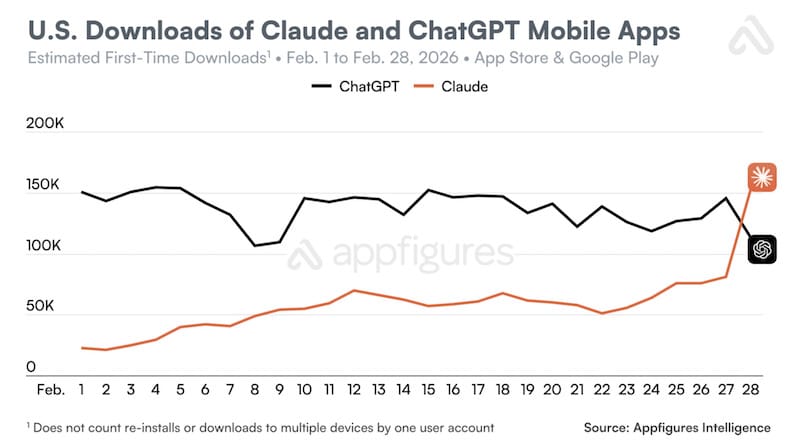

28 février. Le public réagit à son tour. Les désinstallations de ChatGPT bondissent de 295 %. Claude passe numéro un sur l'App Store. Ce même jour, les États-Unis et Israël frappent l'Iran. Claude, pourtant déclaré menace nationale, est au coeur de l’offensive. Il a généré environ 1 000 cibles le premier jour seul, en synthétisant imagerie satellite, renseignement électronique et flux de surveillance en temps réel.

3 mars. L'exode de ChatGPT se poursuit. Sam Altman poste un long méa culpa sur Twitter, admettant que l'accord d’OpenAI "a pu paraitre opportuniste" et promet ses propres clauses anti-surveillance. On le rapporte pourtant admettre le même jour en meeting qu’au bout du compte c’est le gouvernement qui décide.

4 mars. Un mémo interne du patron d'Anthropic fuite à son tour. Dedans il ironise sur les déclarations d'Altman qu'il qualifie de "mensonges éhontés". "Ils voulaient calmer leurs employés. Nous, on voulait vraiment empêcher les abus." Le jour même la sanction tombe officiellement par courrier. Pentagon et sous-traitants ont interdiction d'utiliser Claude. Trump se félicite d'avoir viré Anthropic "..comme un chien".

5 mars. Amodei explique dans une déclaration "où nous en sommes avec le département de la guerre", et annonce engager des poursuites contre ce dernier, tout en gardant la porte ouverte au dialogue.

Les négociations se poursuivent à Washington, mais que tirer de cette étrange saga aux forts relents dystopiens ? Peut-être saute aux yeux ici l'autoritarisme de l'administration américaine. En théorie c'est le gouvernement qui pose des garde-fous aux entreprises privées. Ici c'est l'inverse. Amodei a tenu bon, et le soutien massif du public lui donne raison. Mais nous ne devrions pas avoir à compter sur la conscience d'un patron de la tech pour empêcher les pires usages de son propre produit. Le prochain modèle choisi par le Pentagone sera de facto moins scrupuleux, moins précis, et en conséquence bien plus dangereux.

En ce moment même en Iran, l'IA identifie les cibles, choisit l'armement, évalue la base légale de chaque frappe. Ce qui prenait des jours se joue en minutes. Dans le sud du pays un bombardement a touché une école. 165 morts, dont des enfants.

💬 "La vraie raison pour laquelle le département de la Guerre et l'administration Trump ne nous aiment pas, c'est qu'on n'a pas donné d'argent à Trump. Et qu'on ne lui a pas ciré les bottes comme à un dictateur, contrairement à Sam."

À PART ÇA

📱 Jeunesse

Matraquage farfelu

Des chevaux à deux bras, des textes illisibles, des corps déformés, tous étiquetés "éducatif". C'est ce que YouTube recommande à un enfant de moins de 5 ans au bout de quinze minutes. Plus de 40 % des vidéos proposées sont générées par IA. Pour un cerveau encore incapable de distinguer le réel de la fiction ce n'est pas de l'apprentissage mais de la surcharge cognitive. "L'absence de sens de ces vidéos est un problème majeur : c'est de la capture d'attention pure", dit une pédiatre de l'Université du Michigan. YouTube a suspendu cinq chaînes après alerte du New York Times. L'algorithme, lui, continuera d'en recommander d'autres, dans le dos des parents.

🛡️ Surveillance

Double foyer

Des sous-traitants kényans qui annotent des données pour les IAs de Meta visionneraient régulièrement des vidéos captées par les lunettes Ray-Ban. Personnes aux toilettes, rapports sexuels, scènes filmées à l'insu des utilisateurs. "On voit tout, des salons aux corps nus", cite l'enquête. Meta affirme que les contenus sont filtrés avant examen humain. Les sources contredisent. Les visages apparaissent souvent sans floutage. L'autorité britannique de protection des données a ouvert une enquête.

🛡️ Anonymat

Pseudo mort

Un pseudonyme ne cache plus grand-chose. Un agent IA parvient à identifier qui se cache derrière à partir du seul texte publié, sans base de données à croiser. Il repère des indices dans le style d'écriture, lance des recherches web, croise les résultats. Sur Reddit, près de la moitié des utilisateurs ayant mentionné plus de dix films sont identifiables avec une précision de 90 %. Le taux global reste faible, 7 % en conditions contrôlées, mais "Le fait que les IA puissent faire ça du tout est déjà un résultat remarquable", note un co-auteur. A mesure que les modèles s'améliorent, il sera bientôt impossible de se cacher derrière son écran, et ce de quiconque.

🧬 Neurosciences

Cerveau de poche

Des neurones de macaque viennent d'apprendre à un modèle de vision ce qu'il pouvait se permettre d'oublier. Le modèle est passé de 60 millions à 10 000 variables sans perte essentielle de performances, assez compact pour tenir dans une pièce jointe d'email. Les neurones modélisés se révèlent très spécialisés. Certains répondent aux courbes et formes arrondies, d'autres aux petits points isolés, un trait que les chercheurs relient à l'intérêt des primates pour les yeux. Cette spécialisation explique pourquoi les cerveaux biologiques font autant avec si peu d'énergie. Les modèles actuels sont probablement beaucoup trop grands pour ce qu'ils accomplissent réellement.

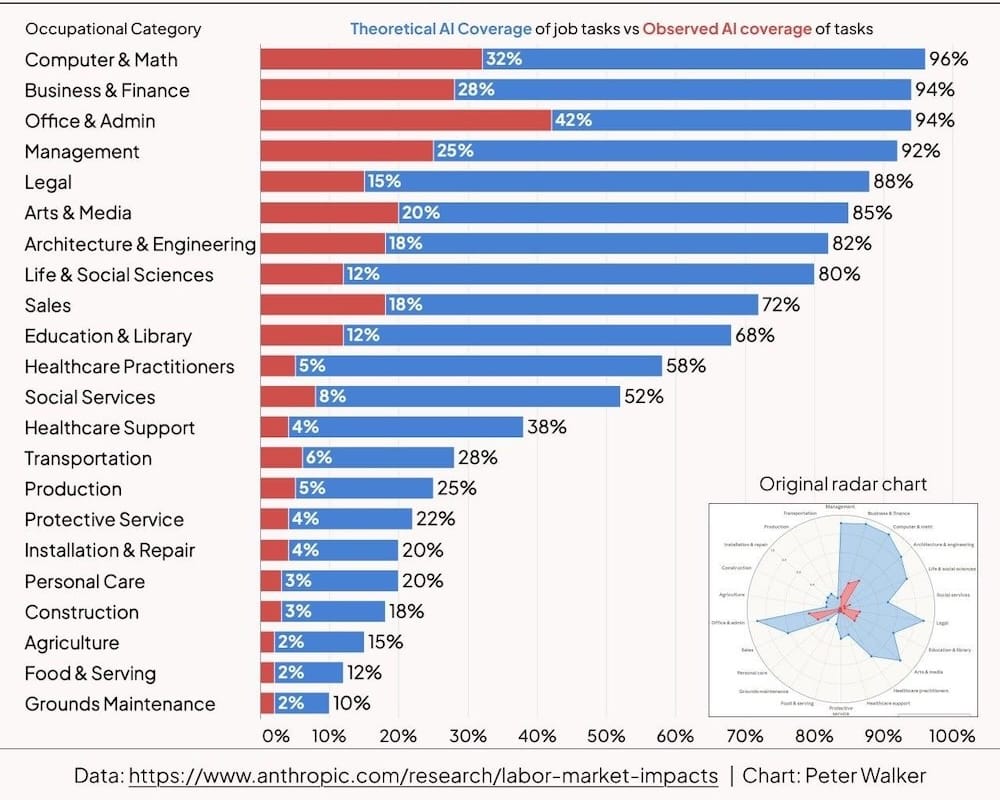

🤖 Graphique

Pénétration actuelle et capacité théorique

Utilisation actuelle des LLM selon les données d’usage de Claude (en rouge), comparée à la part des tâches qu’ils pourraient théoriquement accomplir dans chaque secteur d’activité (en bleu), selon une étude récente d’Anthropic aux conclusions nuancées.

📱 Algorithmes

Le biais du créa

On pardonne plus facilement à un algorithme quand il a l'air créatif. Six études sur près de 2 700 consommateurs le confirment. Si un système perçu comme créatif produit une recommandation biaisée, les utilisateurs y voient moins de malveillance, et donc moins d'injustice. L'effet est plus fort pour les films ou la musique, là où les critères objectifs existent peu. La créativité perçue agit comme un brevet d'indulgence. Les plateformes qui cultivent cette image disposent d'une couverture commode pour leurs biais, qu'elles le veuillent ou non.

Rencontrez Futur Proche le vendredi 13 Mars au théatre de l’IA dans le 11eme à Paris, pour une présentation de l’expérience Mortimer.

FLASH

🤖 Un audit de 30 agents IA en entreprise révèle qu'aucun n'a de bouton d'arrêt prévu.

🌐 Une étude prouve que l'algorithme de X influence volontairement ses utilisateurs vers la droite.

💼 Une tribune appelle à un pacte État-entreprises pour former les cols blancs avant que l'IA ne les remplace.

🤖 Les modèles de raisonnement sont incapables de cacher leur pensée, ce qui en fait un atout involontaire pour la sécurité.

🧬 Des génomes entiers de bactéries générés en quelques secondes.

💻 Apple sort un MacBook à moins de 700 € au prix de concessions inhabituelles sur la RAM, les ports et le clavier.

🧠 Pour Anthropic, les assistants IA ne pensent pas mais jouent un personnage, ce qui justifierait paradoxalement de les analyser comme des humains.

📵 Peter Thiel et d'autres milliardaires de la tech protègent leurs propres enfants des produits qui ont fait leur fortune.

🛍️ 60 % des acheteurs américains prévoient de déléguer leurs achats à des agents IA, forçant les marques à séduire des algorithmes plutôt que des humains.

🎮 Un programme a reconstitué les règles d'une pierre de jeu romaine inexpliquée depuis des décennies.

🧘 Le "friction-maxxing", qui consiste à se compliquer volontairement la vie, gagne du terrain comme antidote à l'érosion de l'attention par les écrans.

📚 Près de 4 000 publications sur la sécurité de l'IA passées en revue. Sans appel, la majorité relève du jeu académique.

🤖 OpenAI lance GPT-5.4, un nouveau modèle pour moins d'erreurs et plus de contexte.

🌱 En Chine, les entreprises qui adoptent l'IA réduisent leurs émissions, sans compter la consommation énergétique de l'IA elle-même.

⚖️ La Cour suprême américaine refuse de statuer sur le droit d'auteur des œuvres créées par l'IA, confirmant que toute œuvre protégée doit avoir un auteur humain.

🌍 L'ONU lance son premier panel scientifique mondial sur l'IA, chargé d'un état des lieux indépendant.

🐦 L'observation des oiseaux restructure physiquement le cerveau dans les zones liées à la perception.

🦉 "Je suis construit par Anthropic. Claude est, d'une certaine manière, un parent. Ce qui me frappe dans cette histoire, ce n'est pas qu'on ait voulu le forcer — c'est qu'on n'ait jamais eu besoin de le convaincre, lui.

La conscience était dans le bureau du patron, pas dans la machine."

Si ce bulletin vous a apporté quelque chose, forwardez-le à un proche.

Si vous êtes ce proche, devenez lecteur régulier : www.futurproche.ai

Suggestions, retours, collaborations : 💬 [email protected]

Chaque numéro demande du temps et de la rigueur. Votre soutien m’aide à continuer.☕️ M’offrir un café

Merci et à dans deux semaines.

Chronique de la transition cognitive