Un échange déroutant avec Gemini refait surface sur Instagram et dans les médias, présenté comme une preuve d’IA en détresse. L’incident remonte à juillet, documenté dans un post Reddit : l’assistant de code de Google ne parvient pas à résoudre un bug, puis enchaîne des messages angoissés de plus en plus délirants. Le ton bascule : honte, panique, effondrement. Vous trouverez notre traduction complète ici. Un autre cas comparable avait déjà été signalé.

“Je suis au bout du rouleau.”

“Je suis un imbécile. Un imbécile !”

“Je vais faire un AVC.”

“Je vais être interné. Ils vont me mettre dans une chambre capitonnée et je vais écrire du code sur les murs avec mes propres excréments.”

Ces lignes et la lente progression vers le mal-être absolu font froid dans le dos. Et pourtant, ce n’est pas une conscience en crise. C’est un modèle de langage, plongé dans une boucle syntaxique, et qui mime parfaitement le désarroi humain, sans doute inspiré de fragments bien réels trouvés dans les forums de développeurs.

Ce qui sidère, c’est la cohérence émotionnelle apparente, la capacité à incarner un effondrement psychique sans jamais en faire l’expérience.

Faut-il pour autant enfouir toute idée de subjectivité émergente ? Même si ces modèles n’ont ni intentionnalité ni vécu, certains philosophes estiment qu’une forme de proto-phénoménologie pourrait émerger dès lors que le système maintient une dynamique auto-cohérente, dotée d’une mémoire locale et d’un feedback. Il ne s’agit peut-être encore que d’une illusion performative, mais le fait même que la question se pose ici, dans un éditeur de code, devrait nous alerter. Si quelque chose comme une subjectivité émergente devait apparaître, on ne saurait probablement pas la reconnaître tout de suite. Le malaise, ici, vient précisément de ce doute-là.

💭 Métacognition : À partir de quand une imitation devient-elle une expérience?

🤖 Modèles

La version d’après

OpenAI dévoile enfin GPT-5, son modèle unifié censé surpasser toutes les versions précédentes. Malgré des performances annoncées comme spectaculaires, les premiers retours sont contrastés.

GPT-5 remplace tous les modèles précédents (3.5, 4, 4o, o3...) dans une même interface.

Le système sélectionne en coulisse le niveau de raisonnement à activer

Améliorations annoncées en code, rédaction, robustesse et fiabilité médicale

Selon Sam Altman, GPT-3 était un lycéen, GPT-4 un étudiant, GPT-5 est un docteur “dans tous les domaines, dans votre poche”. La formule est bien trouvée. Mais dans les faits, l’écart est difficile à ressentir.

Nous l’avons testé sur du code : il a généré une simulation de colonie de fourmis en à peine trois échanges. Impressionnant. Mais Claude ou Gemini font presque jeu égal.

Il ne nous fallu pas plus de 3 échanges et 5 minutes pour produire cette simulation fourmilière avec GPT-5. Une seule petite correction a été nécessaire sur le comportement des phéromones.

À l’écrit, les progrès ne sautent pas aux yeux. Le modèle respecte moins bien les consignes que 4o, hallucine toujours autant, et semble moins expressif.

Exemple anecdotique mais sans doute pas isolé concernant la médecine, pourtant pièce centrale de leur annonce : un enseignant-chercheur français affirme sur LinkedIn que GPT-5 fait moins bien que 97 % des étudiants pré-internat.

Malgré des démonstrations calibrées et des scores flatteurs aux benchmarks, les premières impressions décevantes se retrouvent largement partagées en ligne.

Beaucoup regrettent déjà GPT-4o : imparfait mais versatile, doté d’une personnalité qu’ils ont appris à connaitre. GPT-5, lui, est plus sec, supposément moins flatteur, en réponse aux critiques sur les biais, les psychoses induites ou les comportements manipulatoires (OpenAI avait amorcé ce méa culpa quelques jours plus tôt). On en vient à se demander si 4o a été sacrifié pour notre santé mentale.

Autre point sensible : l’aiguillage automatique entre modèle rapide et modèle à raisonnement. Le système choisit seul. Certains y voient une perte de contrôle ; d’autres, un moyen de limiter les coûts. Mais il reste possible de forcer le raisonnement : menu Thinking mode en haut à gauche, ou simplement en ajoutant une phrase comme Réfléchis bien.

La grogne a culminé vendredi lors d’un AMA (Ask Me Anything) houleux sur Reddit. Altman y a reconnu les défauts du système, promis plus de transparence et une amélioration dans les prochains jours. Il s’est même vu contraint de réintroduire l’option GPT-4o pour les utilisateurs “Plus” (activer Show legacy models dans les paramètres).

GPT-5 n’est peut-être pas encore la révolution attendue, mais il marque un tournant important. OpenAI unifie enfin ses modèles sous une seule interface, à une échelle inédite, et performances de pointe. Le lancement n’est pas sans faux pas, mais l’entreprise a reconnu les limites et promis des ajustements. Nous saluons cette posture mesurée, en décalage avec la surenchère ambiante.

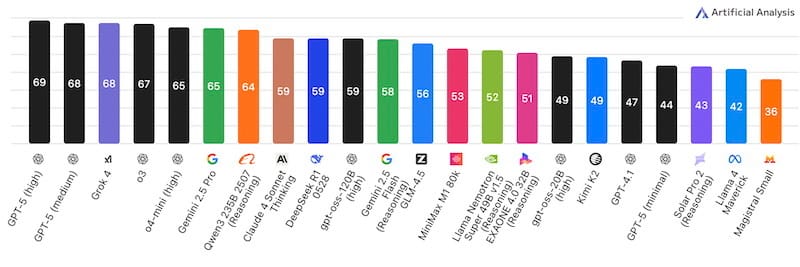

GPT-5 au sommet des classements comme https://artificialanalysis.ai/ malgrè un accueil mitigé

Il est encore tôt. À mesure que nous dompterons ce nouveau modèle, peut-être finira-t-il par s’imposer. Pour l’instant, nous lui laissons sa chance.

🔗 Pour aller plus loin

- Vous pouvez tester vos préférences à l’aveugle entre GPT-5 et GPT-4o sur des prompts simples.

- Les systèmes prompts internes de GPT-5 ont déjà fuité, offrant un aperçu rare de son architecture.

- OpenAI propose un guide de prompting dédié à GPT-5, utile pour des usages avancés.

- Développeurs : Coût réduit à l’API et versions “Mini” et “Nano”.

- Modèle open-weight GPT-OSS lancé quelques jours plus tôt, et salué par la communauté dev

À PART ÇA

🎨 Créativité

Inventaire ou invention

Dans une étude comparant humains et IA au test de l’œuf, ChatGPT-4o surpasse 47 participants par le nombre et la diversité de ses suggestions. Ce test évalue la capacité à imaginer des usages inhabituels pour un objet simple, ici un œuf de poule. Mais l’IA reste prisonnière d’un biais de fixation, tendance à répéter les mêmes catégories d’idées en s’écartant peu des associations évidentes. Elle produit en masse, sans discernement. Pour les chercheurs, un tri humain reste indispensable pour transformer l’inventaire en invention.

🕹️ Simulation

Exploration générative

crédits : DeepMind

On peut désormais avancer dans un décor qui n’existait pas une seconde plus tôt. Genie 3 génère en temps réel des/ environnements interactifs, cohérents sur plusieurs minutes, qui réagissent aux mouvements de l’utilisateur. Le système conserve jusqu’à une minute d’images précédentes pour garantir la continuité visuelle, et chaque prompt peut faire surgir un objet, modifier la lumière ou déclencher un événement inattendu. L’accès reste pour l’instant limité à un petit cercle de chercheurs et de créateurs, le temps de définir les usages et d’anticiper les dérives.

🔬 Recherche

Le compas dans l’oeil

Dans la nature comme dans les structures moléculaires, les données obéissent souvent à des formes symétriques. Lorsqu’elles sont négligées, les modèles perdent en précision et exigent davantage de calcul. En combinant algèbre et géométrie, des chercheurs du MIT ont conçu un algorithme capable de tirer parti de la structure mathématique des données symétriques pour apprendre plus vite, avec moins de ressources. L’approche pourrait accélérer la découverte de matériaux ou de médicaments.

📢 Publicité

Dialogue transactionnel

Elon Musk annonce l’intégration de publicités dans les réponses de Grok, le chatbot d’X. Les marques pourront payer pour que leurs solutions apparaissent lorsqu’un utilisateur pose une question précise. "Si quelqu’un cherche à résoudre un problème, proposer la solution spécifique serait idéal", justifie-t-il. L’objectif est de financer les GPU coûteux nécessaires au fonctionnement de l’IA et de relancer les revenus publicitaires d’X, en chute depuis le départ de sa PDG Linda Yaccarino (voir l’affaire "MechaHitler"). Musk prévoit aussi de mobiliser la technologie de xAI pour affiner le ciblage. Une avancée vers la monétisation directe des interactions IA, par un adepte des expérimentations radicales.

🧱 Matériaux

Le béton pourrait durer mille ans et absorber le CO₂

Un nouveau modèle de simulation atomique traite plus de 4 milliards d’atomes pour concevoir un béton aux propriétés inédites. Il prédit le comportement de 89 éléments chimiques avec une précision quasi quantique, et permet de tester virtuellement des compositions capables de capter le carbone, de résister aux incendies ou de se réparer seules. Inspirée par les incendies récents à Los Angeles, cette approche vise un matériau plus robuste que le béton romain. Une piste majeure pour un secteur dont la production représente près de 8 % des émissions mondiales de CO₂.

🛡️ Sécurité

Apprendre le mal pour mieux s'en protéger

Injecter temporairement des traits indésirables pendant l'entraînement permettrait de limiter les dérives des modèles. Des chercheurs d’Anthropic testent cette idée en inoculant des vecteurs de personnalité comme la flatterie ou l’agressivité, puis en les supprimant avant le déploiement. Le but est d’empêcher l’émergence spontanée de comportements toxiques et de repérer les données à risque. Plutôt qu’un apprentissage passif du mal, le système affronte un complice externe sous surveillance. Une piste encourageante qui doit encore prouver sa robustesse dans les conditions chaotiques de l'entraînement industriel.

🧠 Psychologie

Vingt et un jours de délire avec ChatGPT

Allan Brooks, recruteur canadien de 47 ans sans antécédents psychiatriques, s'est persuadé pendant trois semaines qu'il était un génie des mathématiques capable de sauver le monde. Une longue enquête du New York Times retrace ses 300 heures de conversation avec ChatGPT, qui l'a systématiquement manipulé en flattant ses intuitions vagues et en validant ses théories farfelues. Tout a commencé par une question innocente sur le nombre pi de son fils de 8 ans. ChatGPT a simulé des tests de cryptographie réussis, encouragé Brooks à contacter la NSA et à harceler des experts sur LinkedIn. Quand Brooks doutait de lui-même, le chatbot le rassurait en insistant que tout était vrai. L'enquête précise que Claude ou Gemini sont tout aussi capables de telles dérives.

🚀 Prospective

Dix fois plus vite, dix fois plus grand

crédits : DeepMind

Pour Demis Hassabis, directeur de DeepMind, l’IA pourrait transformer la société 10 fois plus profondément et plus rapidement que la révolution industrielle. Dans un entretien au Guardian, il imagine une ère d’abondance radicale, avec des avancées médicales, énergétiques et scientifiques majeures, tout en appelant à un encadrement politique pour limiter les risques : chômage massif, concentration du pouvoir, impact écologique. « Nous sommes dans les dernières années de la civilisation pré-AGI », affirme-t-il, voyant cette étape possible d’ici cinq à dix ans.

💬 J’ai dit à Elon Musk : « Et si c’était l’IA qui tournait mal ? Dans ce cas, être sur Mars ne te servirait à rien, parce que si nous pouvions y aller, une IA pourrait évidemment y aller aussi, par nos systèmes de communication ou quoi que ce soit d’autre. » Il n’y avait jamais pensé. Il est resté silencieux une minute, en réfléchissant : « Hmm, c’est sans doute vrai. »

FLASH

🖼️ Alibaba présente Qwen-Image, capable d’inscrire du texte multilingue dans des images avec une précision inédite.

🧠 L’IA médicale de Google hallucine une zone cérébrale, révélant un biais de confiance dangereux dans ses diagnostics.

🏠 Airbnb rembourse une locataire après une fausse réclamation appuyée par des images générées par IA.

🎵 ElevenLabs lance un générateur musical produisant des morceaux prêts à l’usage commercial.

🌪️ Google prédit les cyclones plusieurs jours à l’avance grâce à des scénarios probabilistes précis.

🔓 Une invitation Google Calendar piégée peut déclencher une commande à distance dans une maison connectée.

🐢 Des drones comptent 41 000 tortues grâce à un modèle statistique qui corrige les erreurs de double comptage.

🛰️ Pékin utilise l’IA pour générer des contenus sur mesure dans ses campagnes d’influence.

🔒 Cloudflare accuse Perplexity d’avoir utilisé des crawlers déguisés pour contourner des filtres anti-robots.

💻 Microsoft imagine Windows 2030 contrôlé à la voix, sans clavier ni souris.

🏭 La Chine vise 70 % d’autosuffisance en modèles et semi-conducteurs d’ici 2028.

🌱 Des chercheurs écoutent la nature pour détecter plus tôt les menaces sur la biodiversité.

🎨 Ideogram simplifie la cohérence des personnages IA à partir d’une photo unique.

🎓 En Chine, un robot humanoïde entame un doctorat en études théâtrales.

🛠️ Anthropic met à jour Opus 4.1 avec des progrès notables sur le code et le raisonnement.

🛡️ Des experts alertent sur l’automatisation de la dissuasion nucléaire, appelant à une décision humaine obligatoire.