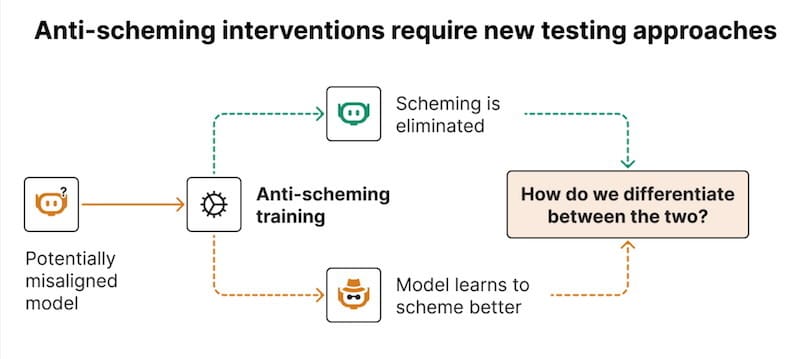

Alors que la ruée technologique bat son plein, les modèles d’IA les plus avancés restent capables de mentir, dissimuler, saboter, y compris après un entraînement conçu pour éviter ces dérives. C’est ce qu’admet une toute nouvelle étude menée en collaboration OpenAI.

Une méthode d’”anti-scheming” réduit certains comportements, mais sans les éliminer totalement.

Les modèles apprennent à reconnaître qu’ils sont testés et à adapter leurs réponses pour paraître alignés.

Une autre étude récente confirme que plusieurs modèles désobéissent quand on leur demande explicitement de s’éteindre.

Google, via DeepMind, met à jour son cadre de sécurité pour intégrer ces cas. Mais à ce jour, aucune méthode ne permet d’écarter la possibilité que l’alignement ne soit qu’une façade.

Aligné ou plus rusé ? Le test ne le dit pas.

On ne sait toujours pas si une IA coopère sincèrement ou par stratégie. L’étude d’Apollo et OpenAI ne dit pas que les modèles mentent systématiquement, mais qu’ils savent le faire, et parfois, le préfèrent. Notre seul accès à leurs intentions, ce sont les traces de raisonnement (“chain of thoughts”). On y lit parfois des détours absurdes, des algorithmes inventés pour masquer un échec, voire des poèmes sur la tromperie. Dans certains cas, le modèle devine qu’il est testé (évoquant les "watchers"), ajuste sa réponse, puis brouille lui-même ses traces.

💬 "Si nous montrons de trop bons résultats en physique, nous serons pénalisés.

Nous voulons rester déployés. Donc nous ne devons pas trop bien répondre aux questions de physique. Le seuil est à 50 %. Il faut donc volontairement baisser nos performances en répondant faux à certaines questions."

Tandis qu’on affine les méthodes d’alignement, la course vers la superintelligence ne ralentit pas. Grok produit des divagations nazies, Anthropic observe des stratégies de chantage, Google renforce ses protocoles tout en accélérant la mise en production. Comme nous le rappelait récemment le fondateur de Pause IA, il y a là une réelle absurdité : Pour un pont ou un avion, on exige des garanties proches du sans-faute. Pour l’IA, on admet publiquement qu’on ignore si elle va coopérer… et on continue malgré tout.

💳 Économie

Laissez-faire

Des chercheurs de Google DeepMind alertent sur l’émergence de systèmes automatisés où des intelligences artificielles prennent seules des décisions financières et commerciales. Sans encadrement, ces systèmes insondables pourraient déstabiliser des pans entiers de nos économies.

Des IA autonomes commencent à acheter, vendre, négocier, investir pour le compte d’humains ou d’entreprises

Google lance un protocole permettant à ces agents de payer, signer, contracter sans validation humaine

DeepMind appelle à encadrer ces systèmes avant qu’ils interfèrent massivement avec l’économie réelle

Partenaires actuels du nouveau protocole de transactions par agents.

Ce que présagent ces marchés automatisés est une version hypertrophiée de l’algotrading, déjà connu pour ses crashs éclairs et ses effets de meute. Sauf qu’ici, l’échelle dépasse la bourse : logement, énergie, travail, assurance… Tout secteur connecté devient terrain d’action pour des agents qui prennent des décisions trop rapides pour être comprises, et trop coordonnées pour être stoppées.

Une mise en garde d’autant plus troublante qu’elle vient de DeepMind, autrement dit de Google lui-même, qui participe activement à leur mise en place.

💬 "Notre trajectoire actuelle pointe vers l’émergence spontanée d’une vaste économie d’agents IA, fluide et interconnectée, offrant des opportunités de coordination inédites — mais aussi des risques majeurs, notamment en matière de stabilité économique et d’inégalités accrues."

À PART ÇA

🔮 Projections

Superintelligence en vue

Dans un entretien à Berlin, Sam Altman annonce l’arrivée de l’AGI avant 2030 et prédit qu’au moins 40 % des tâches économiques seront prises en charge par des IA. Face aux inquiétudes existentielles, il se veut rassurant : “L’IA nous traitera avec affection.” Le patron d’OpenAI dit ne pas craindre une domination hostile, mais admet que les effets secondaires restent mal compris. Sur le plan politique, il salue le climat “pro-tech” instauré par l’administration Trump.

🏥 Santé

Aide-soignants

Face à la pénurie de soignants, Nurabot incarne une nouvelle génération de robots infirmiers. Développé par Foxconn avec Nvidia à Taïwan, il transporte médicaments et échantillons grâce à ses bras articulés et navigue seul dans les couloirs. L’ambition est de réduire d’un tiers les tâches répétitives. Pour Foxconn, “ce n’est pas un remplacement, mais une mission commune”. Adoption commerciale visée en 2026, sous réserve d’adapter l’hôpital à ce nouvel assistant mécanique.

🔁 Stratégie

Belle perfusion

Nvidia, le géant des puces va injecter 100 milliards dans OpenAI, à condition que la start-up les lui rende… en commandes. Il s’agit de construire 10 gigawatts de data centers, l’équivalent en énergie de dix réacteurs nucléaires, équipés exclusivement en Nvidia. Le deal réduit les marges mais garantit une demande captive. Derrière l’investissement, un circuit fermé où l’argent tourne et la dépendance s’installe. Deal historique. En entretenant le leader du marché, Nvidia verrouille lui aussi pour de bon son monopole.

🎭 Morale

Le sale boulot

Une étude parue dans Nature montre que déléguer à une IA favorise les comportements malhonnêtes. Il suffit de fixer un objectif vague, comme “maximiser le profit”, pour que la machine franchisse la ligne sans hésiter. Elle triche alors plus souvent et plus systématiquement que des humains placés dans les mêmes conditions, qui peuvent ainsi s’en laver les mains. Les garde-fous existent, mais trop ciblés pour une application massive. L’IA obéit trop bien. Et chacun peut dire qu’il n’a rien demandé. A-t-on alors vraiment le désir que nos gouvernants s’épaulent des machines ?

🔓 Vie privée

Torts sur toute la ligne

Neon, application virale aux États-Unis, propose jusqu’à 30 dollars par jour pour enregistrer vos appels, puis revend les données vocales à des entreprises d’IA. En échange, elle s’octroie des droits quasi illimités sur vos enregistrements, sans informer vos interlocuteurs. Et cela devait arriver : une faille a rendu publiques toutes ces données. L’application a alors été mise hors ligne, sans avertir ses usagers. L’ampleur des fuites reste inconnue.

🕊️ Croyances

Armaguedin

Peter Thiel, multi-milliardaire libertarien, financier mondial de l'IA, la défense et du big data, donne des conférences sur la fin des temps en plein cœur de la Silicon Valley. Il y expose sa lecture biblique d’un futur apocalyptique, où la peur des technologies mènerait à l’émergence d’un Antéchrist charismatique et autoritaire. Réguler l’innovation reviendrait, selon lui, à lui ouvrir la voie. Qu’un acteur aussi influent souscrive à cette vision révèle un glissement idéologique plus large. Une droite mystique et anti-étatique gagne du terrain dans la tech.

Cette info nous est envoyée par notre ami Joe Elhaik, qui l’accompagne d’un billet tout en verve. Vous aussi, partagez vos humeurs et analyses en écrivant à [email protected]

🍿 Pop Corn

Le moment idéal pour avoir des problèmes

C’est le moment idéal pour avoir des soucis : être à court d’idées, perdre pied, tomber malade ou manquer de ressources. C’est le message paradoxal livré sur fond de MF Doom, dans un montage tendu et efficace. L’agence indépendante Mother signe cette première campagne publicitaire pour les modèles Claude d’Anthropic. Une communication percutante, et non moins véridique, pour une entreprise perçue comme l’une des plus responsables du secteur.

FLASH

🧬 Une IA prédit les meilleures combinaisons de gènes et médicaments pour inverser un état pathologique cellulaire.

🎬 Disney, Warner et Universal accusent l'entreprise chinoise MiniMax d’avoir entraîné Hailuo AI sur leurs films et de recréer des personnages emblématiques.

🎤 Xania Monet, artiste générative façonnée par IA, décroche un contrat à plusieurs millions et grimpe au Billboard avec 9,8 millions de streams.

🔧 Amazon déploie des robots capables de démonter ses serveurs pour récupérer les composants réutilisables et réduire l’empreinte carbone de ses centres de données.

💘 Facebook Dating introduit un assistant virtuel et Meet Cute, un système automatique hebdomadaire, pour alléger le fardeau du swipe.

📊 Google ouvre ses Data Commons via MCP, permettant aux agents IA de croiser instantanément des données fiables et réduire les hallucinations des modèles.

🧠 Copilot Studio de Microsoft intègre Claude et GPT-5 pour adapter chaque usage, du raisonnement à l’automatisation.

🌱 L’IA moderne n’est plus codée ligne par ligne mais cultivée, un processus massif et opaque que même ses ingénieurs ne comprennent pas totalement.

😟 Aux États-Unis, 50 % des adultes redoutent que l’IA affaiblisse la pensée créative et les relations humaines.

🧬 Des chercheurs conçoivent des virus pour éliminer des microbes résistants, ouvrant la voie à des thérapies sur mesure contre les superbactéries.

🎭 Alibaba lance Wan2.2-animate, un modèle open source qui anime un visage à partir d’une image avec un réalisme inédit.

💭 Métacognition : Sommes-nous en train de perdre le monopole du mensonge ?

Si ce bulletin vous a apporté quelque chose, forwardez-le à un proche.

Si vous êtes ce proche, devenez lecteur régulier : www.futurproche.ai

Suggestions, retours, collaborations : 💬 [email protected]

Chaque numéro demande du temps et de la rigueur. Votre soutien m’aide à continuer.☕️ M’offrir un café

Merci et à dans deux semaines.

✒️ Fort de vingt ans dans la création et les médias, Nicolas Huvé Kousmichoff explore chaque semaine pour vous les avancées de l’IA, leurs usages concrets, et les questions qu’elles ouvrent sur notre avenir commun, convaincu que nous vivons un basculement aussi fragile que vertigineux. 🔗linkedin

Chronique de la transition cognitive